服务器信息:

CPU: 16 x Intel(R) Xeon(R) CPU E5-2640 v2 @ 2.00GHz

内存: 64G

硬盘:512G

网速:1G

服务器没GPU,有点辣鸡![]() ,所以回答问题很慢,大概几秒到几分钟都有可能,请耐心等待哈~

,所以回答问题很慢,大概几秒到几分钟都有可能,请耐心等待哈~

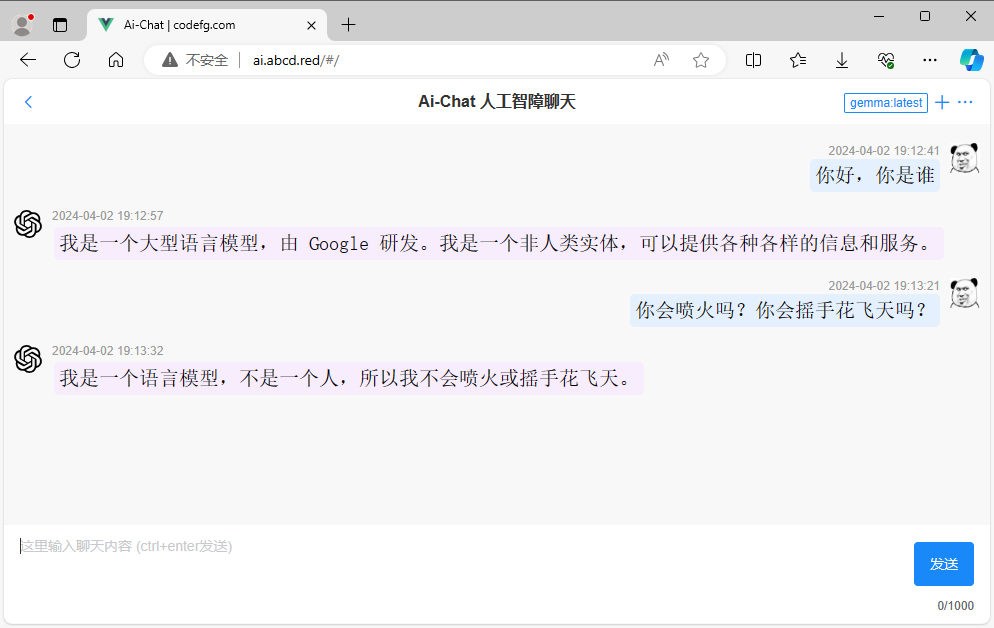

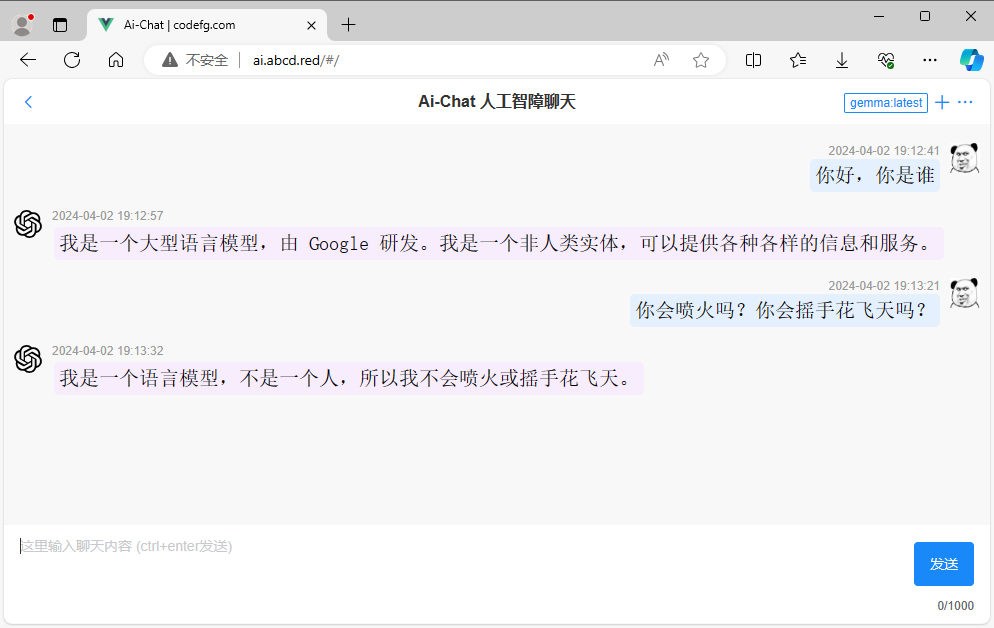

如果你觉得回答的答案不理想,在页面右上角可切换其他模型。目前支持:gemma、llama2、llava、mistral等等。

不用注册,打开即用。

试用地址 http://ai.abcd.red

服务器信息:

CPU: 16 x Intel(R) Xeon(R) CPU E5-2640 v2 @ 2.00GHz

内存: 64G

硬盘:512G

网速:1G

服务器没GPU,有点辣鸡![]() ,所以回答问题很慢,大概几秒到几分钟都有可能,请耐心等待哈~

,所以回答问题很慢,大概几秒到几分钟都有可能,请耐心等待哈~

如果你觉得回答的答案不理想,在页面右上角可切换其他模型。目前支持:gemma、llama2、llava、mistral等等。

不用注册,打开即用。

试用地址 http://ai.abcd.red

| 作者: | admin |

|---|---|

| 目录: | product |

| 创建: | 2024-04-02 |

| 更新: | 2024-04-02 |